Wenn du das nächste Mal einem LLM vorwirfst, dass es halluziniert, wirfst du dem menschlichen Gehirn denselben Vorwurf. Nur dass niemand das so nennt.

Diese Einsicht hat sich mir beim Vorbereiten eines Talks über Memory und State in KI-Agenten aufgedrängt — und sie hat mein Verständnis von KI-Gedächtnis und Memory-Architekturen grundlegend verändert. Im ersten Teil dieser Memory-Serie habe ich die technischen Architekturen gezeigt — von stateless LLMs zu produktionsreifen Memory-Stacks. Dieser Artikel geht eine Ebene tiefer: 140 Jahre Kognitionspsychologie, direkt anwendbar auf die Art, wie wir KI-Agenten mit Gedächtnis ausstatten.

Der Einstieg ist bewusst provokant. Aber er ist korrekt. Lass mich erklären, warum.

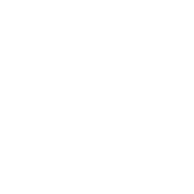

Abbildung: Von 1885 bis 2026 — Kognitionspsychologie und KI-Gedächtnis im historischen Überblick.

Abbildung: Von 1885 bis 2026 — Kognitionspsychologie und KI-Gedächtnis im historischen Überblick.

Bartlett: Gedächtnis ist keine Aufnahme

1932 lässt Frederic Bartlett englische Studenten eine Folklore-Geschichte der First Nations nacherzählen. Das Ergebnis ist eindeutig: Die Probanden verändern die Geschichte systematisch. Übernatürliche Elemente verschwinden, unbekannte Details werden rationalisiert, die Handlung wird in vertraute kulturelle Muster gepresst.

Bartletts Schlussfolgerung war radikal für seine Zeit:

"Remembering is not the re-excitation of innumerable fixed, lifeless and fragmentary traces. It is an imaginative reconstruction, or construction."

Bartlett (1932)

Gedächtnis ist rekonstruktiv, nicht reproduktiv. Wir speichern keine exakten Kopien von Ereignissen wie ein Aufnahmegerät. Stattdessen kodieren wir Information relativ zu bestehenden mentalen Rahmenwerken — Bartlett nennt sie Schemas — und rekonstruieren beim Abruf, wobei wir Lücken mit schematischem Wissen füllen.

Er prägte dafür den Begriff "effort after meaning": den aktiven, oft unbewussten Prozess, neue Informationen mit bestehendem Wissen zu verbinden und eine kohärente Geschichte daraus zu bauen.

Bartlett erklärt LLM-Halluzination

Warum erzähle ich dir das? Weil dieser Prozess exakt das ist, was LLMs tun — und was wir "Halluzination" nennen.

| Bartlett (Mensch) | LLM |

|---|---|

| Schema-basierte Rekonstruktion | Rekonstruktion aus statistischen Mustern |

| "Effort after meaning" — Kohärenz erzwingen | Generiert plausible Details für narrative Konsistenz |

| Verzerrung zum kulturell Vertrauten | Bevorzugt hochfrequente Trainingsmuster |

| Konfabulation bei Wissenslücken | Halluzination bei Unsicherheit |

Der entscheidende Unterschied liegt nicht im Prozess, sondern in einem einzigen fehlenden Element: Reality-Checks. Menschen haben Wahrnehmung, Sinne, Embodiment — laufende Rückkopplungsschleifen mit der physischen Welt, die unsere Rekonstruktionen kalibrieren. LLMs haben das nicht.

Halluzination ist kein mysteriöser KI-Fehler. Es ist derselbe rekonstruktive Prozess wie beim Menschen — nur ohne die Korrektiv-Mechanismen, die beim Menschen dafür sorgen, dass die meisten Konfabulationen nah genug an der Realität bleiben, um unbemerkt zu bleiben.

Diese Perspektive verändert alles. Wir können die Halluzinationsrate senken — durch bessere Grounding-Mechanismen, RAG, strukturierte Ausgaben. Aber wir können Halluzination als Prinzip wahrscheinlich nicht eliminieren. Es ist kein Bug, den man fixen kann. Es ist ein Merkmal rekonstruktiver Informationsverarbeitung.

Das Drei-Speicher-Modell: Atkinson-Shiffrin (1968)

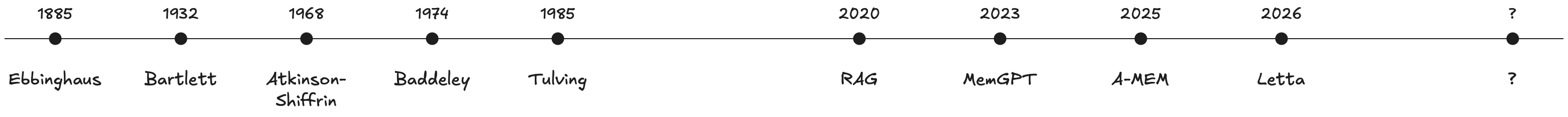

Abbildung: Sensorisches Register, Kurzzeitgedächtnis, Langzeitgedächtnis und ihre KI-Entsprechungen.

Abbildung: Sensorisches Register, Kurzzeitgedächtnis, Langzeitgedächtnis und ihre KI-Entsprechungen.

36 Jahre nach Bartlett formalisieren Richard Atkinson und Richard Shiffrin das erste vollständige Gedächtnismodell. Ihr Multi-Store-Modell beschreibt drei sequentielle Speicher:

- Sensorisches Register — Millisekunden bis etwa 2 Sekunden, hohe Bandbreite, automatische Filterung

- Kurzzeitgedächtnis (KZG) — etwa 7 Items (plus/minus 2), ca. 20 Sekunden ohne aktives Rehearsal

- Langzeitgedächtnis (LZG) — theoretisch unbegrenzte Kapazität und Dauer

Der entscheidende Mechanismus zwischen KZG und LZG ist Rehearsal — der Kontrollprozess, durch den Information aktiv in den Langzeitspeicher überführt wird. Ohne Rehearsal geht Information verloren.

Das KI-Mapping ist direkt und fast erschreckend präzise:

| Atkinson-Shiffrin | KI-Äquivalent |

|---|---|

| Sensorisches Register | Input Buffer / Tokenizer |

| Kurzzeitgedächtnis | Context Window (begrenzt, flüchtig) |

| Langzeitgedächtnis | Persistenter Speicher (Vector DB, Fine-Tuning) |

| Rehearsal | RAG-Loops, Summarization |

MemGPT — heute bekannt als Letta — implementiert genau dieses Modell. Core Memory, Recall Memory, Archival Memory: drei Ebenen, direkt nach Atkinson-Shiffrin. Was 1968 für das menschliche Gedächtnis beschrieben wurde, steckt in einer der fortschrittlichsten KI-Memory-Architekturen von 2023.

Baddeley: Das Arbeitsgedächtnis als aktiver Workspace (1974)

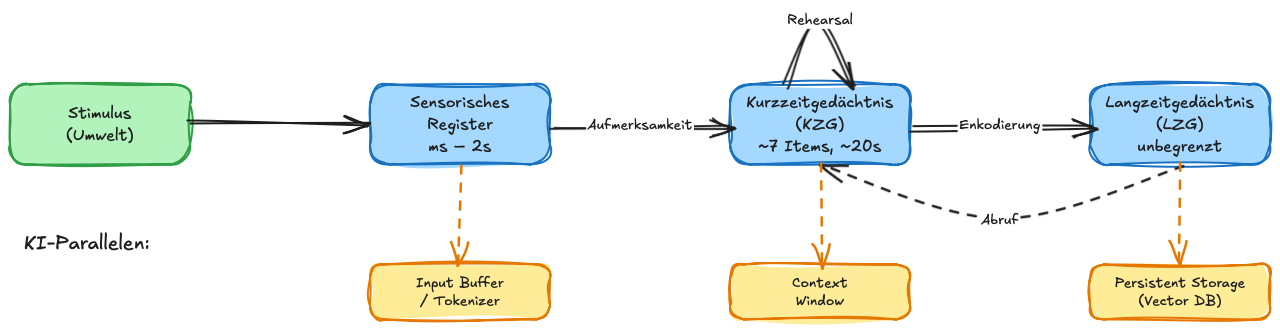

Abbildung: Zentrale Exekutive koordiniert Phonologische Schleife, Visuell-räumlichen Notizblock und Episodischen Buffer — und ihr Mapping auf KI-Agenten.

Abbildung: Zentrale Exekutive koordiniert Phonologische Schleife, Visuell-räumlichen Notizblock und Episodischen Buffer — und ihr Mapping auf KI-Agenten.

1974 korrigiert Alan Baddeley Atkinson-Shiffrin in einem entscheidenden Punkt: Das Kurzzeitgedächtnis ist kein passiver Speicher — es ist ein aktiver Workspace mit einer Führungsstruktur.

Baddeleys Working-Memory-Modell beschreibt:

- Zentrale Exekutive — Das Aufmerksamkeitskontrollsystem. Sie lenkt Fokus, koordiniert Subsysteme, managed Task-Switching. Domänenübergreifend, kapazitätsbegrenzt.

- Phonologische Schleife — Verarbeitet verbale und akustische Information.

- Visuell-räumlicher Notizblock — Hält und manipuliert visuelle und räumliche Information.

- Episodischer Buffer (2000 ergänzt) — Integriert Information aus allen Subsystemen und dem Langzeitgedächtnis zu kohärenten Episoden.

Das Mapping auf KI-Agenten ist elegant:

| Baddeley | KI-Agent |

|---|---|

| Zentrale Exekutive | LLM als Orchestrator (ReAct-Loop, Chain-of-Thought) |

| Phonologische Schleife | Text-Processing-Pipeline |

| Visuell-räumlicher Notizblock | Vision Encoder (GPT-4V, CLIP) |

| Episodischer Buffer | Context Window als Integrationsraum |

Das Context Window ist nicht einfach "Speicher". Es ist Baddeleys Episodischer Buffer: der Raum, in dem RAG-Ergebnisse, System Prompt und User-Input zu einer kohärenten Repräsentation verschmelzen. Und das LLM selbst ist die Zentrale Exekutive — es koordiniert Tools als "Slave-Systeme", genau wie Baddeley es für das menschliche Gehirn beschreibt.

Tulving: Drei qualitativ verschiedene Gedächtnissysteme (1972/1985)

Endel Tulving (1927–2023) stellt die vielleicht folgenreichste Frage in der Gedächtnisforschung: Gibt es wirklich ein einheitliches Langzeitgedächtnis — oder sind es mehrere qualitativ verschiedene Systeme?

Seine Antwort, die er ab 1972 entwickelt und 1985 konsolidiert: Es sind mindestens drei:

Episodisches Gedächtnis — Persönlich erlebte Ereignisse, gebunden an Zeit und Ort. "Gestern beim Meeting hat Maria gesagt..." Tulving nennt das zugehörige Bewusstsein autonoetisch — das subjektive Gefühl, ein vergangenes Ereignis wirklich wieder zu erleben, nicht nur davon zu wissen.

Semantisches Gedächtnis — Fakten, Konzepte, Bedeutungen, losgelöst vom Lernkontext. "Paris ist die Hauptstadt Frankreichs." Das Bewusstsein ist noetisch — man weiß etwas, ohne es zu re-erleben.

Prozedurales Gedächtnis — Skills, Gewohnheiten, Routinen. Fahrradfahren, ohne nachzudenken. Das Bewusstsein ist anoetisch — man kann etwas, ohne bewusst zu wissen wie.

CoALA: Tulvings Taxonomie als KI-Architektur-Standard

Hier wird es spannend für die KI-Forschung. Das CoALA Framework (Cognitive Architectures for Language Agents, Sumers et al. 2023/2024, TMLR 2024) — entwickelt an Stanford und Princeton — übernimmt Tulvings Taxonomie direkt und ohne Umwege:

| Tulvings System | KI-Äquivalent |

|---|---|

| Episodisches Gedächtnis | Konversationslogs, Agent-Trajektorien, Interaktions-Records mit Zeitstempeln |

| Semantisches Gedächtnis | RAG-Dokumentspeicher, Wissensbasen, Fine-Tuning-Gewichte |

| Prozedurales Gedächtnis | Modellgewichte (gelernte Fähigkeiten), Tool-Use-Patterns, RLHF-Policies |

Kognitionspsychologie aus den 1970ern fließt direkt in einen KI-Architektur-Standard von 2023. Die Lücke zwischen diesen Feldern ist kleiner, als sie aussieht.

Generative Agents: Tulving in der Praxis (2023)

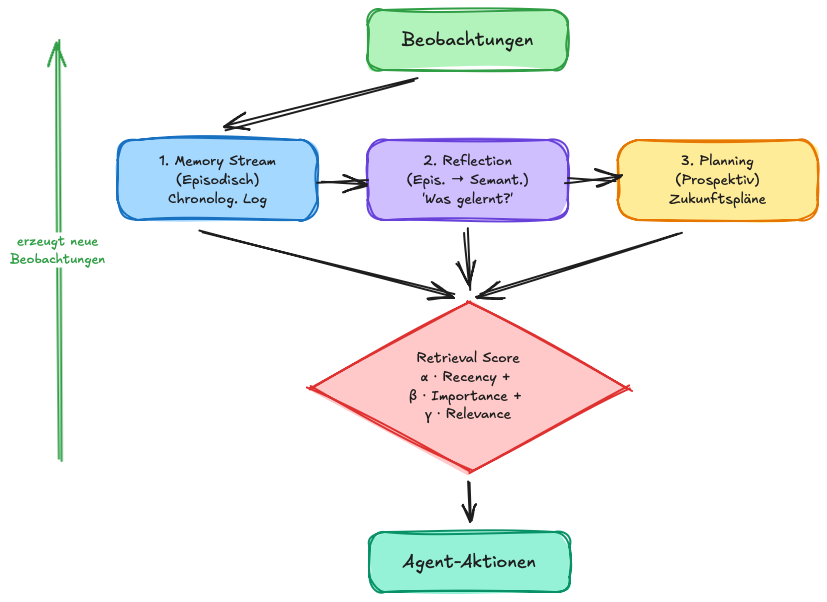

Abbildung: 25 KI-Agenten in einer simulierten Kleinstadt — Memory Stream, Reflection und Planning implementieren Tulvings Gedächtnismodell direkt.

Abbildung: 25 KI-Agenten in einer simulierten Kleinstadt — Memory Stream, Reflection und Planning implementieren Tulvings Gedächtnismodell direkt.

Das bekannteste Beispiel für Tulving in der Praxis ist die Arbeit von Park et al. (2023): Generative Agents (UIST 2023). 25 KI-Agenten leben in einer simulierten Kleinstadt — eine Art KI-gestützte "The Sims" — mit einem vollständig ausgearbeiteten Memory-System.

Das System hat drei Komponenten, die Tulving direkt implementieren:

Memory Stream — Ein chronologisches Log aller Beobachtungen. Das ist episodisches Gedächtnis in seiner reinsten Form: zeitgebundene Ereignisse mit Kontext.

Reflection — Periodisch synthetisieren die Agenten ihre Episoden: "Was habe ich gelernt?" Aus episodischen Einträgen werden semantische Erkenntnisse. Genau der Prozess, den Tulving als episodisch-zu-semantische Konsolidierung beschreibt.

Planning — Aus Erinnerungen werden Zukunftspläne abgeleitet. Mehr dazu im nächsten Abschnitt.

Besonders interessant ist der Retrieval-Score, der bestimmt, welche Erinnerungen in einem Moment abgerufen werden:

Score = α x Recency + β x Importance + γ x Relevance

Dieser Score imitiert menschliche Gedächtnis-Zugänglichkeit: Neue Erinnerungen, wichtige Erinnerungen und gerade relevante Erinnerungen kommen leichter in den Fokus. Das Ergebnis: Emergentes soziales Verhalten. Agenten organisierten Partys, bildeten Meinungen — und erinnerten sich aneinander.

Ebbinghaus: Warum KI vergisst (1885)

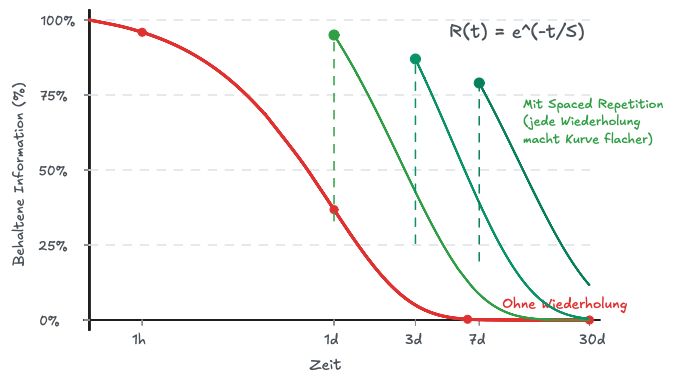

Abbildung: Exponentielles Vergessen bei Mensch und KI — von Ebbinghaus 1885 bis zu modernen Catastrophic-Forgetting-Strategien.

Abbildung: Exponentielles Vergessen bei Mensch und KI — von Ebbinghaus 1885 bis zu modernen Catastrophic-Forgetting-Strategien.

Hermann Ebbinghaus macht sich 1885 selbst zum Versuchsgegenstand. Er lernt sinnlose Silbenreihen und misst systematisch, wie schnell er sie vergisst. Das Ergebnis ist die erste quantitative Theorie des Vergessens: Die Retention zerfällt exponentiell:

R = e^(-t/S)

Konkret: Etwa 56% der Information wird innerhalb einer Stunde vergessen, etwa 75% innerhalb von sechs Tagen. Aber jede Wiederholungssitzung "resettet" die Kurve — mit flacherem Abfall. Daraus entstand das Prinzip der Spaced Repetition, heute in jedem ernsthaften Lernprogramm implementiert.

Die KI-Parallelen sind direkt:

| Ebbinghaus-Konzept | KI-Äquivalent |

|---|---|

| Vergessenskurve | Catastrophic Forgetting — Training auf Task B zerstört Performance auf Task A |

| Context-Zerfall | "Lost in the Middle" — Tokens in der Mitte des Context Windows erhalten progressiv weniger Attention |

| Spaced Repetition | Experience Replay — periodisches Re-Training auf vergangenen Daten |

| Wichtige Erinnerungen priorisieren | EWC (Elastic Weight Consolidation) — wichtige Parameter vor Überschreibung schützen |

Ein 2025er Paper (arXiv:2506.12034) liefert die bisher überzeugendste empirische Bestätigung: Die Autoren messen an Multi-Layer Perceptrons die Recall-Probability über Hidden-State-Ähnlichkeit zu gespeicherten Prototyp-Repräsentationen und vergleichen die resultierende zeitliche Degradation mit dem Ebbinghaus-Modell. Das Ergebnis ist eindeutig: Die Vergessenskurven der MLPs folgen eng dem menschlichen Muster — steiler Abfall zu Beginn, Verlangsamung über die Zeit, signifikante Verbesserung durch geplante Reviews (das maschinelle Äquivalent von Spaced Repetition). Die Autoren schließen daraus, dass neuronale Netze eine Architektur darstellen, die natürlich die Dynamik des menschlichen Gedächtniszerfalls nachbildet.

Das führt zu einer interessanten Umdeutung: Vergessen ist nicht ein Bug neuronaler Netze, der sich mit genug Engineering eliminieren ließe. Es ist ein fundamentales Tradeoff zwischen Kapazität, Generalisierung und Verfügbarkeit — ein Tradeoff, den man managen, aber nicht auflösen kann. Damit erhält die Bartlett-Halluzinations-These ein Pendant auf der Vergessens-Seite: Auch das Vergessen ist kein Fehler des Systems, sondern ein Merkmal lernender Systeme.

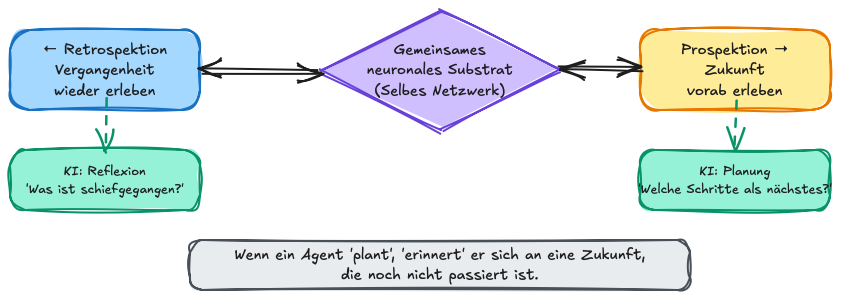

Mental Time Travel: Erinnern und Planen sind dasselbe

Tulvings tiefste Einsicht kommt 1985 und wird 2002 weiter ausgearbeitet: Episodisches Gedächtnis ermöglicht mentales Zeitreisen.

- Retrospektion — sich in der Zeit zurückprojizieren, um vergangene Ereignisse wieder zu erleben

- Prospektion — sich in der Zeit vorprojizieren, um mögliche zukünftige Ereignisse vorauszuerleben

Das Entscheidende: Dieselben neuronalen Netzwerke — medialer Präfrontalkortex, Precuneus, Hippocampus — unterstützen beides. Gedächtnis und Planung teilen ein gemeinsames Substrat.

"By mentally playing and replaying past events, as well as constructing and evaluating possible future scenarios, mental time travel allows us to plan for the future in uniquely flexible ways."

Suddendorf & Corballis (2007)

Abbildung: Erinnern und Planen nutzen dieselben neuronalen Netzwerke — und beim LLM denselben Mechanismus.

Abbildung: Erinnern und Planen nutzen dieselben neuronalen Netzwerke — und beim LLM denselben Mechanismus.

Für KI-Agenten ist das unmittelbar relevant. Dasselbe LLM, das vergangene Erfahrungen zusammenfasst ("Was ist beim letzten Versuch schiefgegangen?"), generiert auch Zukunftspläne ("Welche Schritte sollte ich als nächstes tun?"). Der Mechanismus ist identisch — nur anders konditioniert.

Wenn ein Agent "plant", erinnert er sich an eine Zukunft, die noch nicht passiert ist. Das ist kein philosophisches Gedankenspiel. Es erklärt, warum Reflexion und Planning in Agent-Architekturen so eng verbunden sind und warum sich dieser Ansatz so natürlich anfühlt: Er greift auf denselben Mechanismus zurück, den das menschliche Gehirn seit Jahrtausenden nutzt.

Das Drei-Komponenten-System der Generative Agents — Memory Stream, Reflection, Planning — ist damit vollständig durch Tulving erklärt: Retrospektion wird zu Reflexion, Prospektion wird zu Planning.

Was die Psychologie noch lehren kann

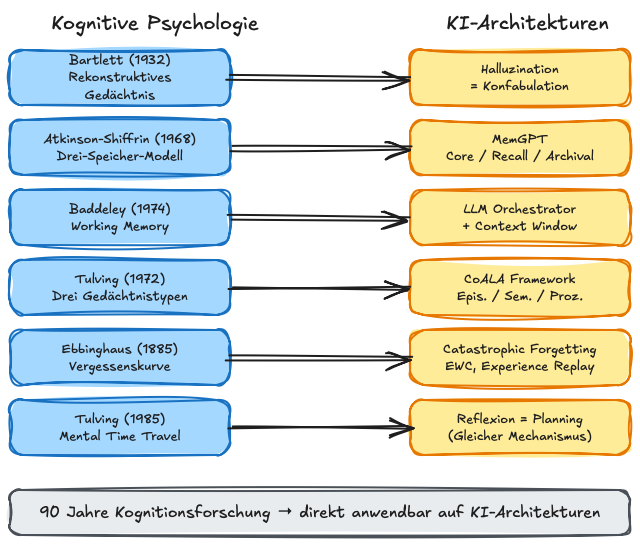

Abbildung: Von Bartlett bis Tulving (Mental Time Travel) — sechs kognitive Modelle und ihre direkten KI-Entsprechungen.

Abbildung: Von Bartlett bis Tulving (Mental Time Travel) — sechs kognitive Modelle und ihre direkten KI-Entsprechungen.

Viel Kognitionsforschung ist bereits in KI-Architekturen eingeflossen. Aber es gibt ungenutztes Potenzial, das mich fasziniert:

Emotionale Salienz — Emotionale Erinnerungen werden stärker und dauerhafter gespeichert. Könnten Wichtigkeits-gewichtete Memory-Systeme für Agenten ähnlich funktionieren? Der Retrieval-Score der Generative Agents hat einen Importance-Faktor — aber was "wichtig" ist, wird noch relativ simpel bestimmt.

Schlafkonsolidierung — und ihre KI-Implementierung: "Dreaming". Im Schlaf reorganisiert das Gehirn Erinnerungen: stärkt wichtige, bereinigt Redundantes, verknüpft Zusammenhängendes. Im ersten Teil dieser Serie habe ich Auto-Dream als Trend bereits angeteasert — hier folgt die ausführliche Einordnung, zusammen mit Lettas Sleep-Time Agents.

Letta (die Weiterentwicklung von MemGPT) hat Sleep-Time Agents eingeführt: Hintergrund-Subagenten, die in Leerlaufphasen zwischen aktiven Sessions Memory prunen, mergen und auffrischen. Das ist funktional dasselbe wie nächtliche Gedächtniskonsolidierung — mit messbarem Ergebnis: 18% Accuracy-Gewinn und 2.5-fache Kostenreduktion pro Query. Schon die Generative Agents (Park et al. 2023, s.o.) hatten einen Reflection-Mechanismus, der periodisch episodische Erinnerungen zu semantischen Erkenntnissen verdichtet — auch das eine Form der Konsolidierung, allerdings inline statt offline.

Claude Code (Anthropic, 2026) geht mit Auto-Dream noch einen Schritt weiter. Das Feature nimmt die Sprache der Neurowissenschaften direkt auf und beschreibt sich selbst als Analogon zur "memory consolidation during REM sleep — the neurological process by which the brain converts short-term experiences into long-term, organized memories". Der Zyklus hat vier klar abgegrenzte Phasen:

- Orientation — Claude liest die bestehende Memory-Struktur und das MEMORY.md-Indexfile.

- Gather Signal — Gezielte Suche nach Hochwert-Signalen (Benutzerkorrekturen, Save-Commands, wiederkehrende Themen), nicht vollständige Transkript-Reviews.

- Consolidation — Relative Datumsangaben werden in absolute Timestamps konvertiert, widersprüchliche Fakten entfernt, veraltete Einträge bereinigt und überlappende Notizen zusammengeführt.

- Prune and Index — Der MEMORY.md-Index wird unter 200 Zeilen gehalten.

Der Zyklus läuft automatisch an, wenn mindestens 24 Stunden seit dem letzten Lauf vergangen sind und mehr als 5 Sessions stattgefunden haben. In einem getesteten Memory-Ordner schrumpfte der Inhalt nach einem Zyklus von über 280 auf unter 200 Zeilen. Aus Sicherheitsgründen ist Auto-Dream read-only bezüglich des Quellcodes und läuft nie während aktiver Sessions; ein Lock-File-Mechanismus verhindert Race Conditions. Stand März 2026 ist das Feature als server-seitiges Flag (tengu_onyx_plover) gebaut, aber noch nicht breit aktiviert.

Das Konzept baut auf UC Berkeleys "Sleep-time Compute"-Forschung (2025) auf, die zeigte, dass Vorverarbeitung in Leerlaufphasen den Inference-Compute um etwa das 5-Fache reduzieren kann. Die Richtung ist klar: Memory-Konsolidierung wird vom optionalen Feature zur Standardkomponente.

Self-Search: Abruf als aktives Werkzeug. Ein weiterer Trend schließt direkt an die Kognitionspsychologie an: explizite Selbstsuche in der eigenen Geschichte. Der Hermes Agent (Nous Research, Februar 2026) arbeitet mit einer sauberen Zweiteilung:

| System | Wo | Rolle |

|---|---|---|

| Persistent Memory | MEMORY.md + USER.md | "Frozen snapshot" im System Prompt — ~1.300 Token, instant verfügbar |

| Session Search | SQLite + FTS5 in state.db | Unbegrenzt, durchsucht alle vergangenen CLI- und Messaging-Sessions |

Die Dokumentation bringt es präzise auf den Punkt: "Memory is for critical facts that should always be in context. Session search is for 'did we discuss X last week?' queries." Per session_search-Tool durchsucht der Agent seine eigene Vergangenheit — bewusst, gezielt, on-demand. Kein automatischer Retrieval wie bei RAG, sondern ein aktiver Abrufprozess, den der Agent selbst initiiert.

Nous Research selbst gibt keine kognitionspsychologische Motivation an — das System ist rein pragmatisch gebaut. Aber die Parallele drängt sich auf: Session Search entspricht dem bewussten, strategischen Erinnern — Bartletts "effort after meaning", nur nicht auf Rekonstruktion, sondern auf Suche angewendet. Der Mechanismus ist radikal simpel (kein Vector-DB, kein Embedding), aber konzeptuell bedeutsam: Der Agent weiß, dass er eine Vergangenheit hat, und kann aktiv in ihr recherchieren.

Prospektives Gedächtnis — "Vergiss nicht, morgen X zu tun." Menschen sind gut darin, sich selbst zeitgebundene Erinnerungen zu setzen. Timer-basierte Memory-Trigger für Agenten wären eine direkte Umsetzung.

Soziales Gedächtnis — Wir erinnern anders in Gruppen: als Teil eines kollektiven Gedächtnisses, mit geteilten Referenzpunkten und verteilter Erinnerungsarbeit. Wie würden Multi-Agent-Systeme als Gruppe erinnern?

Die Mapping-Tabelle

Bevor wir zu den offenen Fragen kommen, ein Überblick über alles bisher Erarbeitete:

| Kognitives Modell | Jahr | Core Insight | KI-Architektur |

|---|---|---|---|

| Bartlett | 1932 | Rekonstruktiv, nicht reproduktiv | Halluzination = Konfabulation |

| Atkinson-Shiffrin | 1968 | Drei sequentielle Speicher | MemGPT: Core/Recall/Archival |

| Baddeley | 1974 | Aktiver Workspace + Exekutive | LLM als Orchestrator + Context Window |

| Tulving | 1972 | Episodisch/Semantisch/Prozedural | CoALA: 3 Memory-Typen für Agents |

| Ebbinghaus | 1885 | Exponentielles Vergessen | Catastrophic Forgetting, EWC |

| Tulving | 1985 | Mental Time Travel | Reflexion = Planning |

Mehr als 90 Jahre Kognitionsforschung — direkt anwendbar auf KI-Architekturen, die heute in Produktion laufen.

Offene Fragen

Die spannenden Fragen sind die, die die Kognitionsforschung selbst noch nicht abschließend beantwortet hat:

Brauchen wir echtes Bewusstsein für echtes Gedächtnis? Tulving sagt, echtes episodisches Gedächtnis setzt autonoetisches Bewusstsein voraus — das Selbst-Gewahrsein, das das Wiedererinnern von bloßem Fakten-Wissen unterscheidet. LLMs haben kein Selbst-Bewusstsein. Haben sie damit per Definition kein echtes episodisches Gedächtnis — oder reicht funktionales Gedächtnis, das dieselben Aufgaben erfüllt?

CoALA gibt darauf eine pragmatische Antwort. Das Framework übernimmt Tulvings strukturelle Taxonomie (episodisch, semantisch, prozedural), aber nicht die bewusstseinsbezogene Definition. Implizit beantwortet CoALA die Frage mit: Ja, funktionales Gedächtnis reicht — solange es die richtigen Aufgaben erfüllt. Ein Agent, der Konversationslogs mit Zeitstempeln abruft und auf sie reagiert, verhält sich nach außen wie jemand mit episodischem Gedächtnis, ganz ohne subjektives Wiedererleben. Das ist elegant, aber nicht kostenlos: Aufgaben, die echtes subjektives Erinnern voraussetzen — autobiografische Identitätskohärenz, emotionale Bindung an frühere Episoden — bleiben für solche Systeme prinzipiell unerreichbar. Die offene Frage ist damit nicht beantwortet, aber klarer zugeschnitten: Nicht "haben LLMs ein Gedächtnis?", sondern "für welche Aufgaben ist funktionales Gedächtnis ausreichend, für welche reicht es prinzipiell nicht?"

Ist Halluzination lösbar — oder inhärent? Wenn Bartlett recht hat und Memory fundamental rekonstruktiv ist, dann ist Konfabulation kein Bug. Können wir nur die Rate senken, aber nie auf null? Das hätte praktische Konsequenzen dafür, wie wir KI-Systeme designen und welche Vertrauensannahmen wir treffen.

Wer kontrolliert das Gedächtnis? Self-Managed Memory — der Agent entscheidet selbst, was er sich merkt — ist die Richtung, in die sich die Forschung bewegt. MemGPT hat das eingeläutet. Aber das wirft sofort ethische Fragen auf: Consent, Transparenz, Right to be Forgotten. Brauchen wir "Gedächtnis-Governance" für KI-Systeme?

Eine interessante Teilantwort gibt Letta selbst: Am 12. Februar 2026 kündigte Letta Context Repositories an — eine Memory-Architektur für Coding-Agenten (Letta Code), die Agent-Memory wie Source Code behandelt: versioniert, verzweigbar, merge-fähig. Agent-Kontext wird als Dateien im lokalen Dateisystem gespeichert, jede Änderung automatisch per Git versioniert, mit informativen Commit-Messages. Wo MemGPT Memory wie Betriebssystem-Speicher verwaltet, erweitern Context Repositories die Analogie um eine Versionskontroll-Schicht. Das ist nicht die Antwort auf "Wer kontrolliert?", aber es ist ein Werkzeug für "Wie machen wir Kontrolle sichtbar?": Parallele Agenten-Instanzen arbeiten in Worktrees, die Memory-Evolution ist vollständig auditierbar, und konfligierende Erinnerungen werden als Merge-Konflikte sichtbar statt still überschrieben. Governance beginnt mit Beobachtbarkeit — und Git-für-Memory ist ein verblüffend naheliegender Ansatz.

Emergiert Metacognition aus Memory? Wenn ein Agent über seine eigenen Erinnerungen reflektiert — ist das nicht der Beginn von Metacognition? Das wäre die nächste Stufe: KI, die nicht nur ein Gedächtnis hat, sondern ihr eigenes Gedächtnis bewertet und versteht. Genau diese Frage habe ich in einem eigenen Artikel über Metacognition und selbstlernende KI-Agenten vertieft.

Fazit: 140 Jahre als Design-Ressource

Die Kognitionspsychologie ist keine historische Kuriosität. Sie ist eine direkt nutzbare Design-Ressource für KI-Architekturen.

Bartlett (1932) erklärt, warum Halluzination inhärent ist. Atkinson-Shiffrin (1968) steckt in MemGPT. Baddeley (1974) beschreibt, warum das LLM als Orchestrator funktioniert. Tulving (1972/1985) definiert die Memory-Typen, die CoALA als Architektur-Standard implementiert. Ebbinghaus (1885) erklärt Catastrophic Forgetting und zeigt, warum Experience Replay funktioniert.

Wer diese Muster versteht, trifft bessere Architekturentscheidungen. Nicht weil die KI-Forschung bewusst Psychologie kopiert — sondern weil gute Lösungen für das Gedächtnisproblem offenbar eine tiefe Konvergenz aufweisen, egal ob sie in einem biologischen oder einem digitalen System implementiert werden.

Eine Frage zum Mitnehmen: Verändert die Bartlett-Perspektive dein Verständnis von Halluzination — und wenn ja, was bedeutet das für die Systeme, die du baust oder nutzt?

Weiterführende Quellen

- Bartlett, F.C. (1932). Remembering: A Study in Experimental and Social Psychology. Cambridge University Press.

- Atkinson, R.C. & Shiffrin, R.M. (1968). "Human Memory: A Proposed System and Its Control Processes." The Psychology of Learning and Motivation, Vol. 2.

- Baddeley, A.D. & Hitch, G. (1974). "Working Memory." The Psychology of Learning and Motivation, Vol. 8.

- Tulving, E. (1972). "Episodic and Semantic Memory." In Organization of Memory.

- Tulving, E. (1985). "How Many Memory Systems Are There?" American Psychologist.

- Ebbinghaus, H. (1885). Über das Gedächtnis. Duncker & Humblot.

- "Human-like Forgetting Curves in Deep Neural Networks." arXiv:2506.12034 — Juni 2025.

- Suddendorf, T. & Corballis, M.C. (2007). "Mental Time Travel and the Shaping of the Human Mind." PNAS.

- Sumers, T.R. et al. (2023/2024). "Cognitive Architectures for Language Agents." arXiv:2309.02427. TMLR 2024.

- Park, J.S. et al. (2023). "Generative Agents: Interactive Simulacra of Human Behavior." arXiv:2304.03442. UIST 2023.

- Hu, Y. et al. (2025). "Memory in the Age of AI Agents: A Survey." arXiv:2512.13564.

- Nous Research. "Hermes Agent: Memory." hermes-agent.nousresearch.com

Dieser Artikel erschien ursprünglich auf dem Mayflower Blog.