Halluzination ist kein Bug — 140 Jahre Kognitionsforschung erklären warum

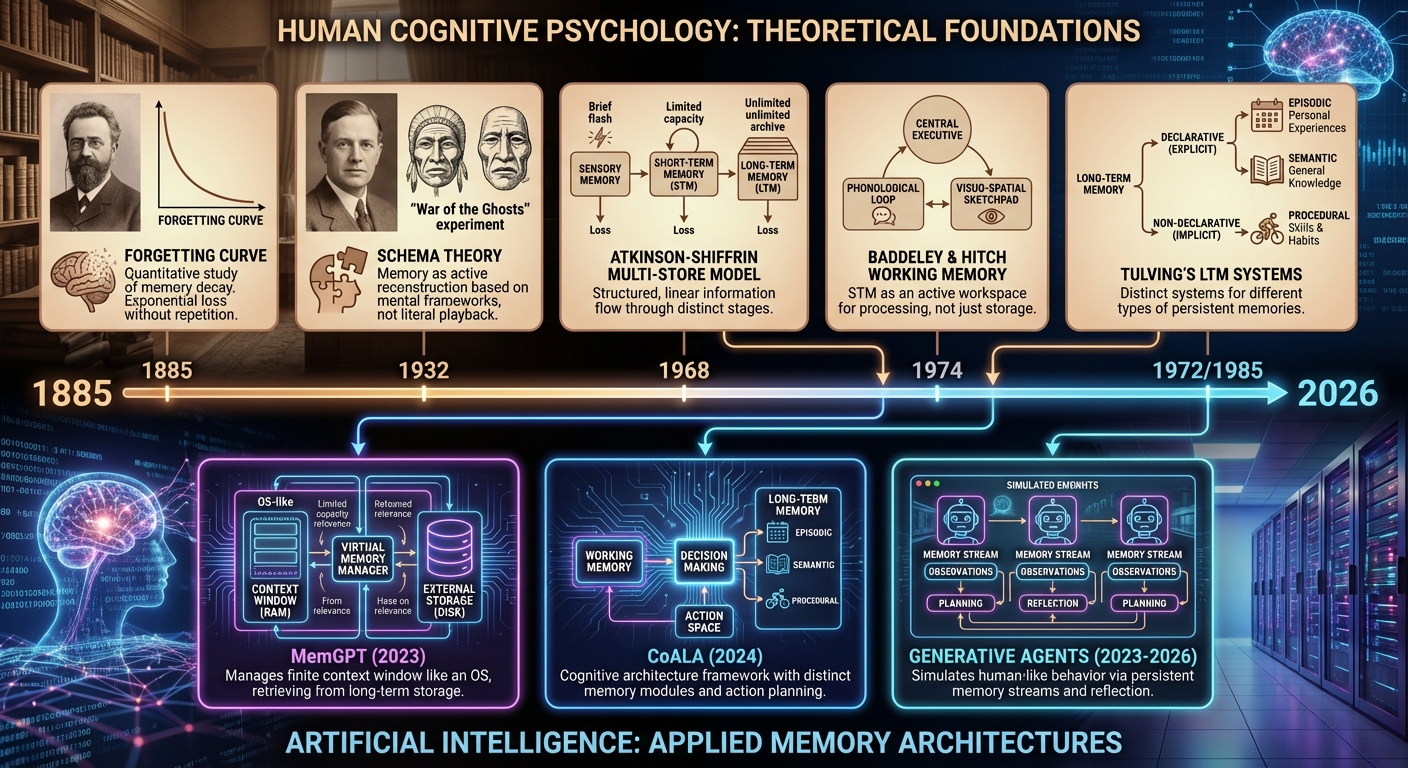

Von Bartletts Konfabulation bis Ebbinghaus' Vergessenskurve — sechs kognitive Modelle, direkt gemappt auf LLMs und Agent-Memory-Architekturen.

Von Bartletts Konfabulation bis Ebbinghaus' Vergessenskurve — sechs kognitive Modelle, direkt gemappt auf LLMs und Agent-Memory-Architekturen.

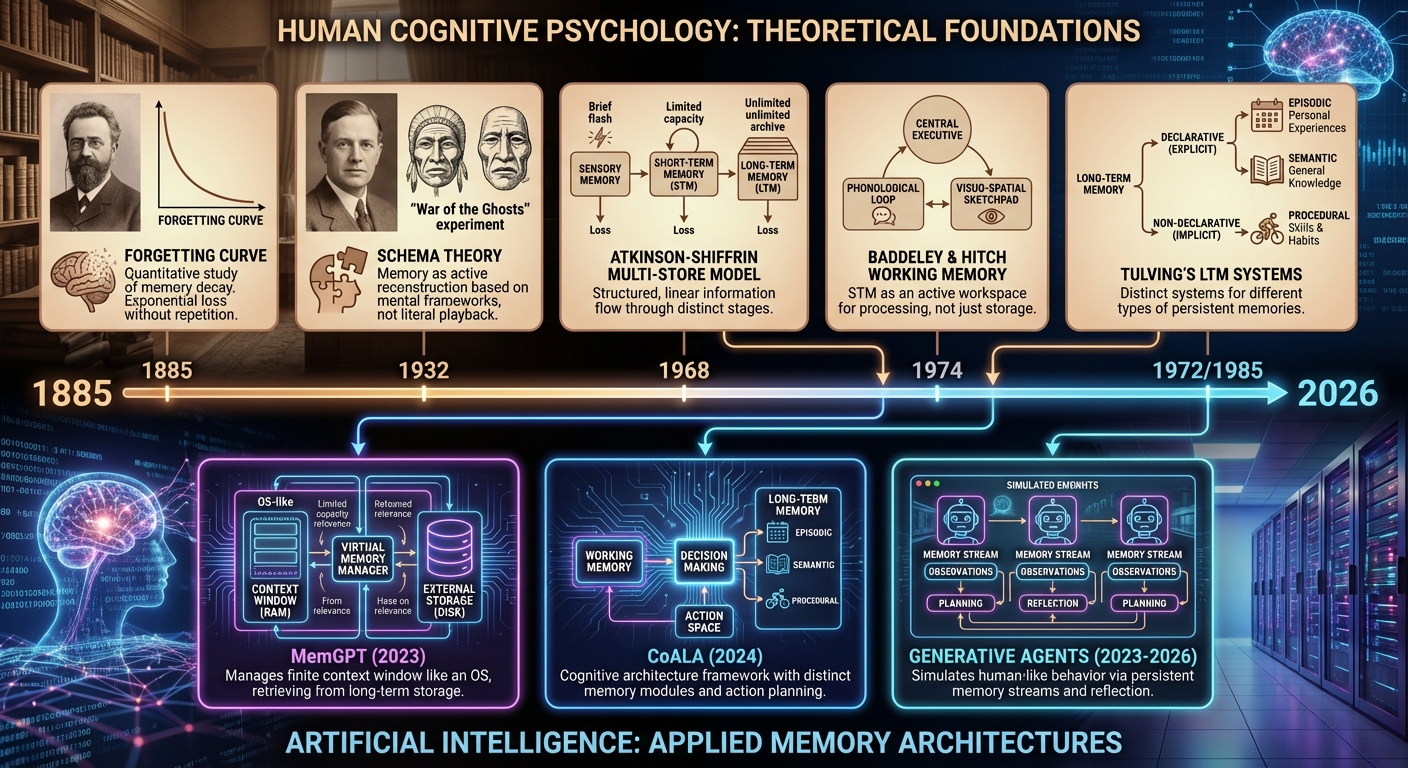

Jeder LLM-API-Call ist ein Clean Slate — 8 Memory-Architekturen im Vergleich: Context Window, RAG, MemGPT, Mem0, Zep, LangGraph und File-basierte Ansätze.

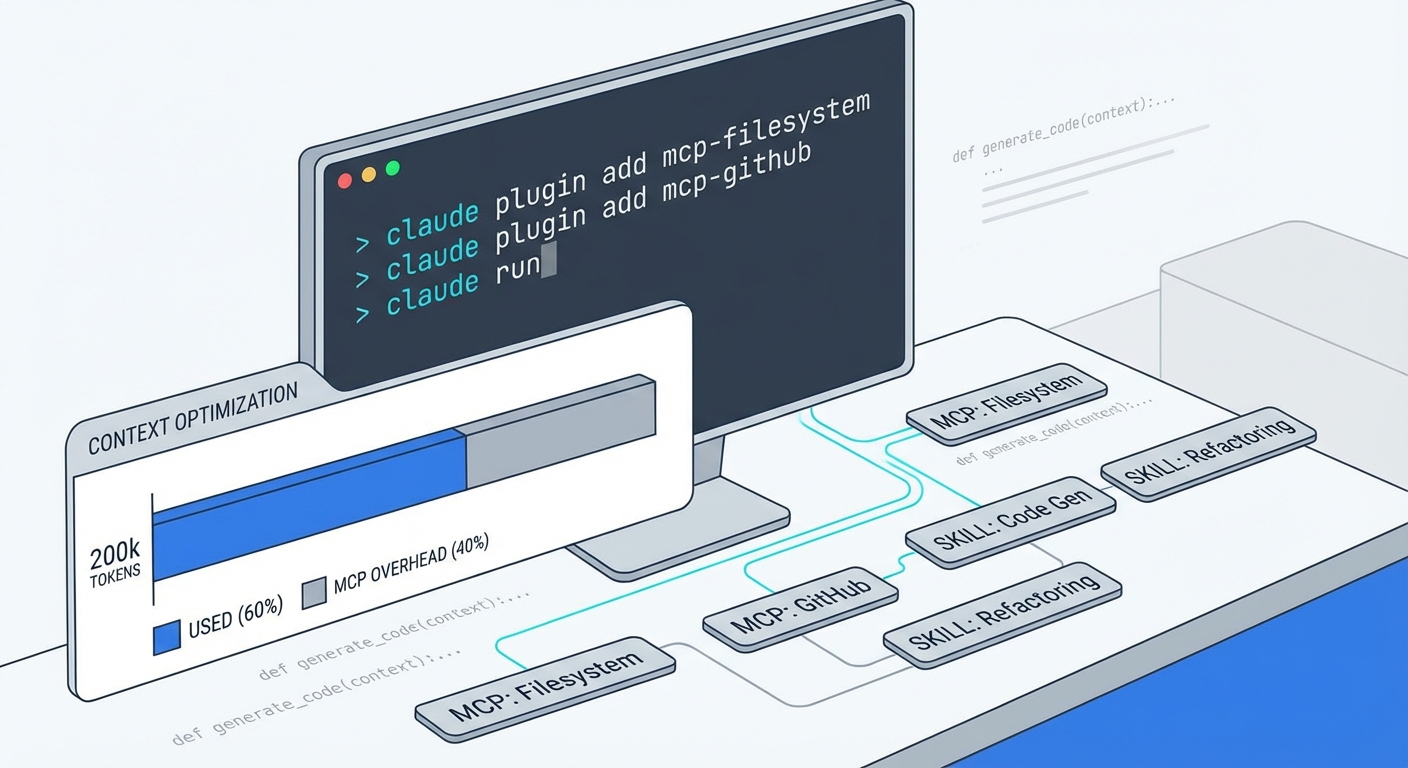

Browser DevTools MCPs, ContextMine, Session-Mining und parallele Instanzen — was sich seit Januar verändert hat und warum tiefere Integration mehr bringt als mehr Tools.

Nach drei Monaten und $6.000 API-Kosten — was bleibt: Handover-Patterns, Quality Gates und der Übergang zu Claude Code.

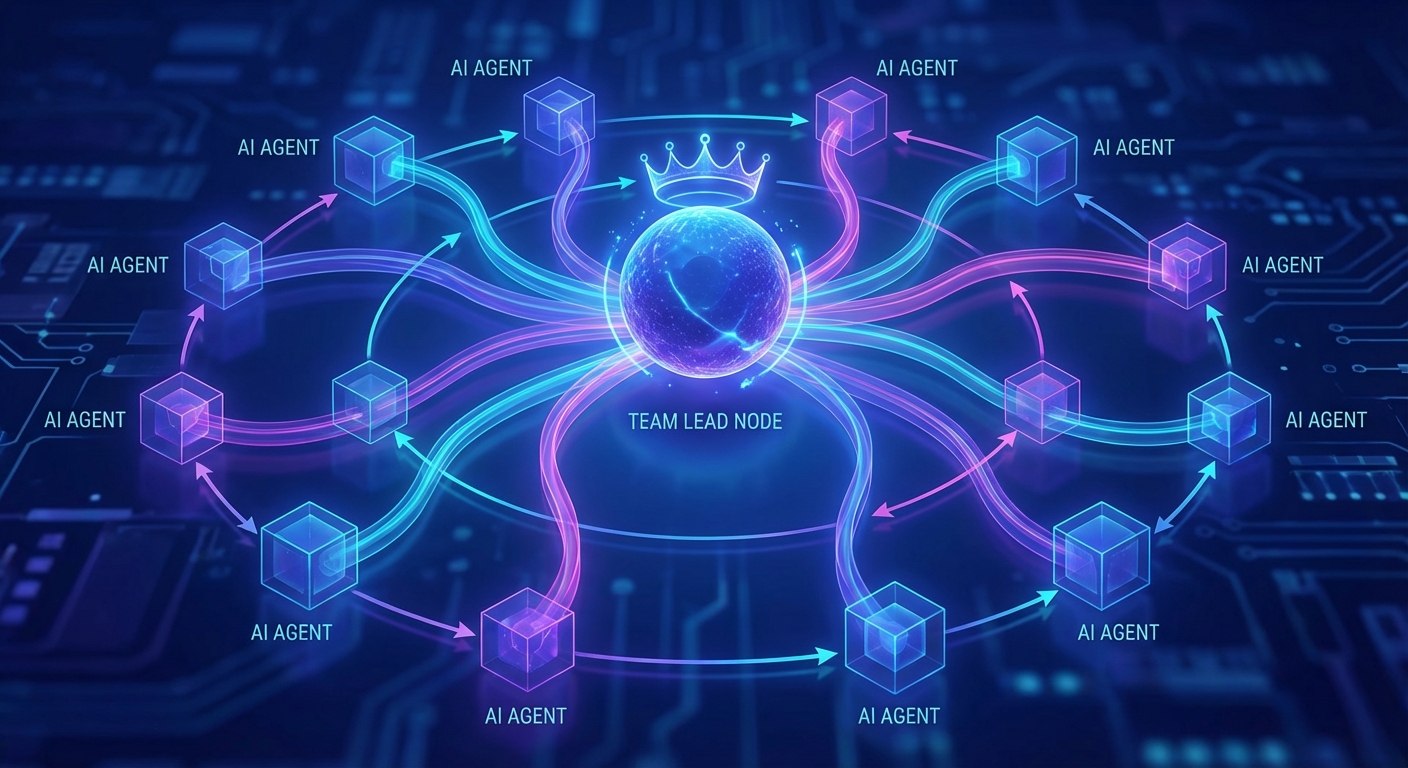

Over-Engineering, Mode Drift, Context-Overflow — echte Probleme und Lösungen aus der Entwicklung eines Multi-Agent-Systems mit 15 KI-Modi.

Wie Handover-Patterns, Quality Gates und eine Rule Hierarchy 15 spezialisierte AI-Modi zu einem orchestrierten Agile Development Team koordinieren.

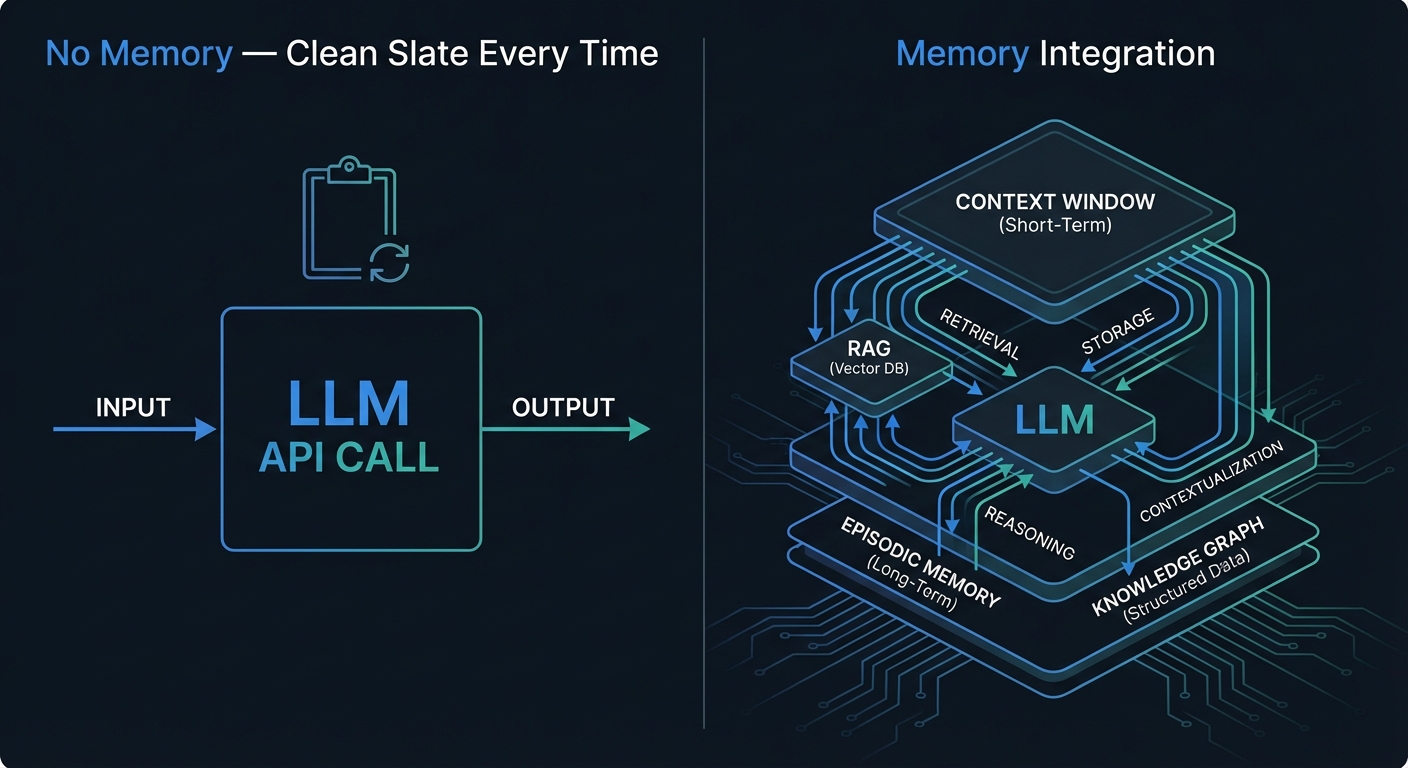

Erzwungener Wechsel von JetBrains zu VSCode wurde zum Wendepunkt — 15 spezialisierte AI-Modi, 118 Commits in 3 Tagen, ein selbst-organisierendes Entwicklungsteam.

Language Server, Superpowers, Context7 und v2.1.0 Security-Fix — meine essentiellen Tools nach 3 Monaten intensiver Nutzung.

Warum GPT-3.5 den Bat-Ball-Test versagt, GPT-4 mit Chain-of-Thought aber besteht — und wie TRAP, Reflexion und LATS KI-Agenten das Lernen aus Fehlern beibringen.